micomia株式会社でAIエンジニアをしている松久保です。

本記事では、OpenCVとYOLOを用いて構築した車両カウントシステムについてご紹介します。どのような技術を使い、どのような仕組みで車両を検出・追跡しカウントしているのか、実装のポイントも含めてわかりやすく解説していきます。

目次

1. はじめに

今回作成したシステムは、ノートパソコン 上でも動作する軽量構成であり、主に Python・Ultralytics YOLO・OpenCV というシンプルな技術スタックで実現しています。

車両検出 & 分類 → 追跡 → ライン交差によるカウント という処理フローで動作し、交通量調査やインフラ監視などの用途にも応用できる実用的な仕組みになっています。

2. 使用技術について

本システムは Python をベースに、主に YOLO(Ultralytics YOLO11) と OpenCV を組み合わせて構築しています。

YOLOは軽量・高速・高精度な物体検出モデルで、車両の検出 (Detection)と 追跡 (Tracking) を一貫して行うことができます。

OpenCVは、動画の読み込み、描画、ライン交差のチェック、そして最終的な動画出力など、処理全体の制御を行っています。

アーキテクチャ

本システムは「入力動画 → 検出・追跡 → ライン交差判定 → カウント」というシンプルな処理パイプラインで構成されています。

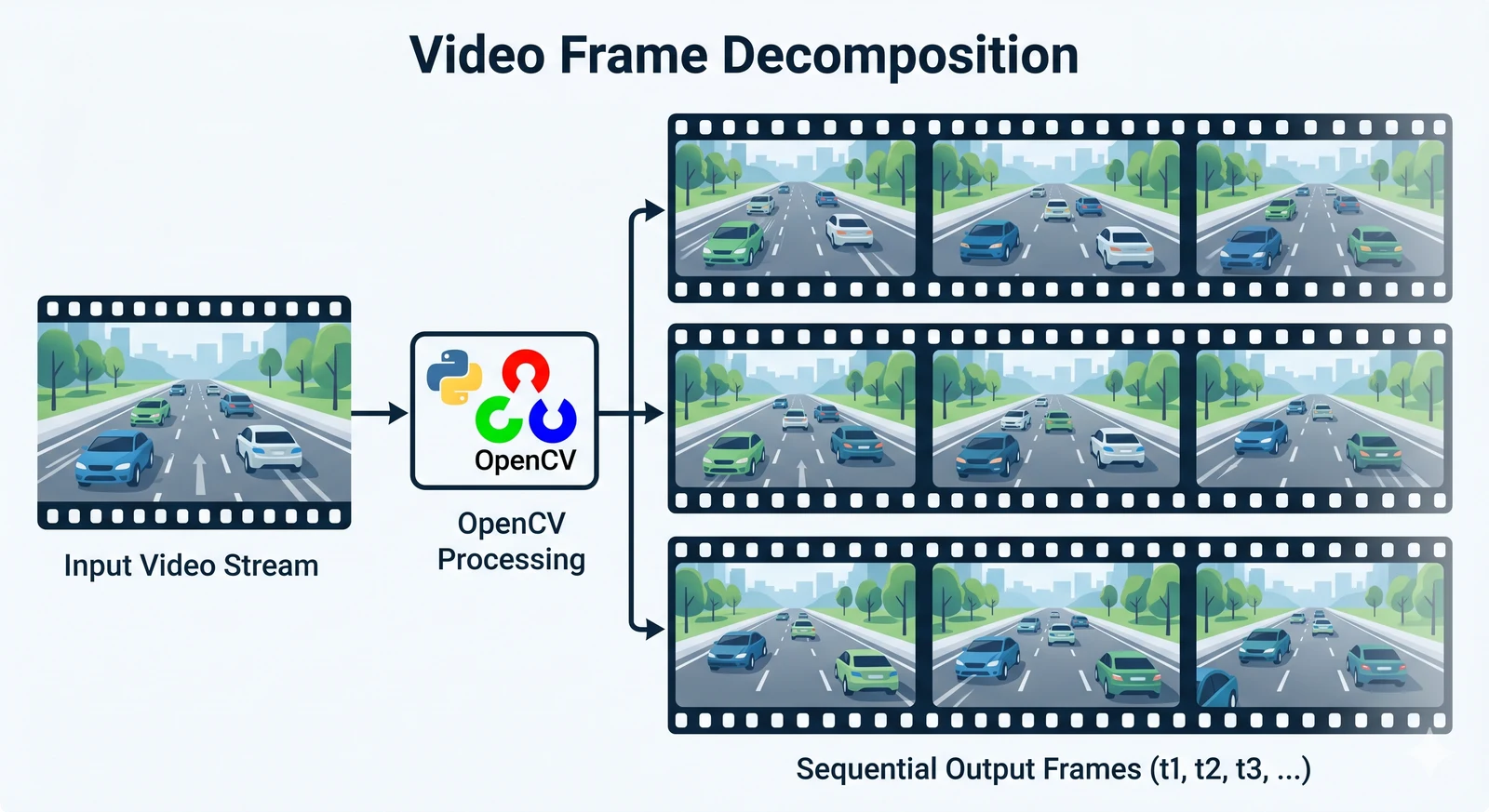

1. 入力動画のフレーム分割

Python と OpenCV を用いて入力動画を読み込み、1フレームずつ画像として取り出します。以降の処理はすべてフレーム単位で行われます。

2. YOLOによる車両検出・トラッキング

各フレームに対して YOLO を適用し、車・バイク・バス・トラックを検出・分類します。track モードを使用することで、各車両に対して位置(バウンディングボックス)、クラスID、トラッキングIDが付与され、同一車両をフレーム間で一貫して追跡できます。

.webp?alt=media&token=4949c296-c69e-40f7-8df4-7d4796528b00)

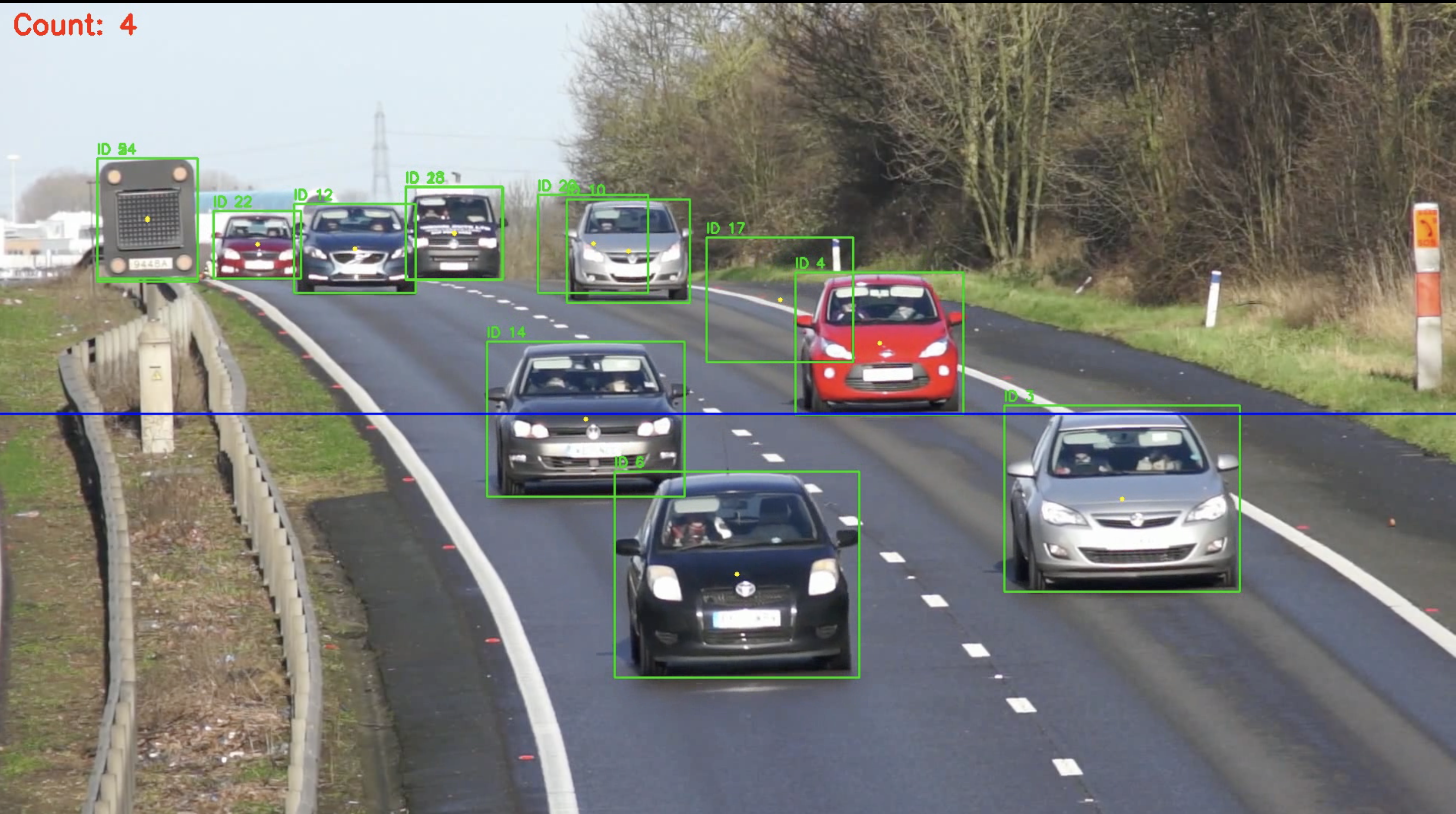

3. カウントライン交差の判定

画像中に1本のカウントライン(本実装では画像中央の水平線)を設置し、各トラッキングIDごとに「前フレームの位置」と「現在フレームの位置」を比較します。車両の位置がカウントラインの上側から下側へ移動したタイミングで、その車両をカウントします。

.webp?alt=media&token=ec63c50c-f745-4ac7-b3de-ecbec46f5d4b)

3. コード・実装の解説

ライブラリのインポートと基本設定

必要なライブラリのインポートと、モデルや入力・出力ファイルのパスなどの基本設定を行います。

import cv2

from ultralytics import YOLO

# Config

MODEL = "yolo11l.pt"

INPUT_VIDEO = "input_path"

OUTPUT_VIDEO = "output_path"モデル読み込みと動画入出力の初期化

YOLOモデルをロードし、OpenCVで動画の読み込み・書き込みの準備をします。

model = YOLO(MODEL)

cap = cv2.VideoCapture(INPUT_VIDEO)

if not cap.isOpened():

print("Error: Could not open video.")

exit()

fps = int(cap.get(cv2.CAP_PROP_FPS))

w = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

h = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fourcc = cv2.VideoWriter_fourcc(*'mp4v')

out = cv2.VideoWriter(OUTPUT_VIDEO, fourcc, fps, (w, h))カウント用の変数定義

車種ごとのカウンタや、トラッキングIDの履歴を管理するための変数を定義します。

class_counts = {

'car': 0,

'motorcycle': 0,

'bus': 0,

'truck': 0

}

CLASS_NAMES = {2: 'car', 3: 'motorcycle', 5: 'bus', 7: 'truck'}

counted_ids = {}

track_history = {}メインループ:フレームごとの処理

動画を1フレームずつ処理し、検出 → 追跡 → ライン交差判定 → カウント表示を行います。

while True:

ret, frame = cap.read()

if not ret:

print("End of video stream.")

break

result = model.track(frame, classes=[2, 3, 5, 7], persist=True, tracker="bytetrack.yaml")

annotated_frame = result[0].plot()ライン交差の判定とカウントロジック

各トラッキングIDごとに「前フレームの位置」と「現在の位置」を比較し、ラインより上側 → ラインより下側に移動したタイミングでカウントします。

line_y = h // 2

cv2.line(annotated_frame, (0, line_y), (w, line_y), (0, 255, 255), 2)

if result[0].boxes.id is not None:

boxes = result[0].boxes.xywh.cpu()

track_ids = result[0].boxes.id.int().cpu().tolist()

class_ids = result[0].boxes.cls.int().cpu().tolist()

for box, track_id, class_id in zip(boxes, track_ids, class_ids):

class_name = CLASS_NAMES.get(class_id)

if not class_name:

continue

car_position_y = int(box[1])

current_side = 'top' if car_position_y < line_y else 'down'

if track_id in counted_ids:

continue

if track_id in track_history:

prev_side = track_history[track_id]

if prev_side == 'top' and current_side == 'down':

class_counts[class_name] += 1

counted_ids[track_id] = class_name

track_history[track_id] = current_sideカウント結果の描画と動画出力

最後に、フレーム上にカウント結果を描画し、動画として保存します。

total_count = sum(class_counts.values())

count_text = f"TOTAL: {total_count}"

details_text = " | ".join([f"{k}: {v}" for k, v in class_counts.items()])

cv2.putText(annotated_frame, count_text, (10, 50), cv2.FONT_HERSHEY_SIMPLEX, 1.2, (0, 0, 255), 3)

cv2.putText(annotated_frame, details_text, (10, 100), cv2.FONT_HERSHEY_SIMPLEX, 0.7, (255, 255, 0), 2)

cv2.imshow('YOLO11l Detection', annotated_frame)

out.write(annotated_frame)

if cv2.waitKey(1) & 0xFF == ord('q'):

break

cap.release()

out.release()

cv2.destroyAllWindows()

print(f"Processing done. Saved to {OUTPUT_VIDEO}")4. 実行結果

YOLO と OpenCV を組み合わせて、シンプルな構成で動作する車両カウントシステムを実装しました。

YOLOによる検出と ByteTrack を利用した追跡により、車両がカウントラインを通過するタイミングを高い精度で捉えることができました。

Python と軽量な技術スタックのみで動作するため、ローカル環境でも手軽に試せるほか、交通量調査や映像解析の自動化など、さまざまな用途に応用できます。

.webp%3Falt%3Dmedia%26token%3D6ca2c2ef-9413-4453-b992-55b66b11ed54&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3Da7c14698-1b08-4fea-89c6-f77a9121f4c5&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D900f385d-12a2-449b-8d1e-83a57cef0088&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D0e802fb0-2dda-44a7-bf80-5d39019635ba&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D899eeefd-f4c9-44a6-9ec2-3ced0b223ffd&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3Dca25fa6b-e233-43f7-90c3-e68e4c5b0bc5&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D3fb3dc66-ecca-402e-8fb8-fbec9407f7f5&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D7f18e5f1-cfda-4148-ab86-b3d2e6547262&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3Ddb21d760-e1ed-4ec2-af28-3462041e31b5&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3Dcce7bd72-f11e-4292-86bf-e6ccf3e7bf32&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D457ff920-e0df-4ff5-95eb-e29f74b73823&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3Dc21fcc77-7404-458d-9eb5-85b8d84ae1bc&w=3840&q=75)

.webp%3Falt%3Dmedia%26token%3D92052f12-5280-49df-877a-b514582e95db&w=3840&q=75)